Sono passati solo pochi mesi da quando abbiamo parlato dell'introduzione dell'IA generativa in Photoshop nella sua prima forma definitiva (conclusa cioè la fase beta), avvenuta con la versione 25.0 del programma. Ciò non di meno, è già il momento di parlare del primo sostanzioso aggiornamento del pacchetto IA, reso disponibile in fase beta con la versione Photoshop V25.8.

Di che si tratta? Essenzialmente, di maggior qualità delle immagini generate e maggior controllo su di esse, grazie soprattutto alla possibilità di utilizzare immagini di riferimento per meglio indirizzare l'IA. Da non sottovalutare, comunque, i vantaggi pratici della maggior integrazione nell'interfaccia di Photoshop, con la possibilità, per la prima volta, di utilizzare la funzione detta da testo a immagine (generazione di immagini attraverso un prompt testuale) direttamente entro il programma.

Prima di procedere a esaminare più in dettaglio le novità, però, è bene richiamare l'attenzione su alcune limitazioni introdotte da Adobe a partire da inizio anno (17 gennaio 2024).

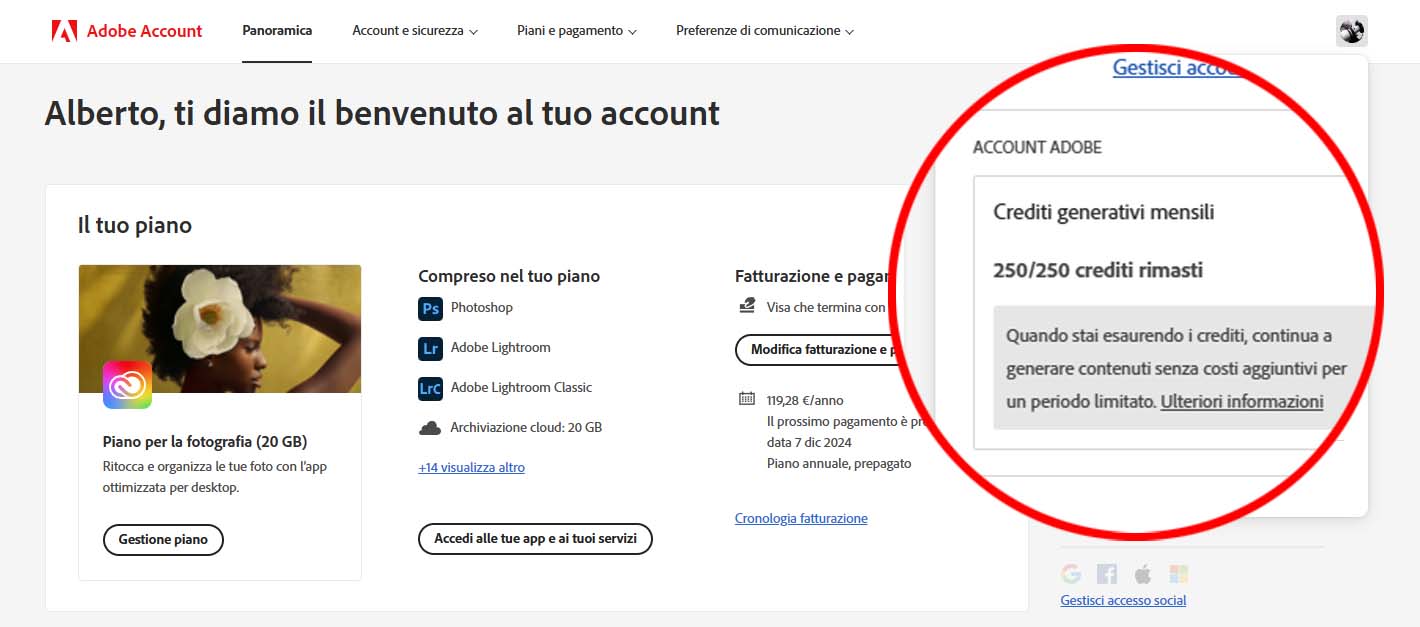

La generazione di immagini grazie all'IA è, come noto, computazionalmente (quindi energeticamente) dispendiosa, e non sarà più possibile utilizzarla in modo indiscriminato. Adobe ha introdotto, allo scopo, i cosiddetti crediti generativi, moneta spendibile per creare contenuti basati su IA.

Questi crediti, che si rinnovano mensilmente (senza possibilità di accumulo dei crediti non utilizzati) vengono elargiti in quantità dipendente dal tipo di abbonamento ad esempio, il piano Fotografia 1 TB vale 500 crediti generativi mensili, mentre la sola App Cloud Lightroom ne vale 100. Esistono anche casi, come quello del piano Fotografia 20 GB, in cui la quantità di crediti dipende dalla data di sottoscrizione dell'abbonamento. Rimandiamo al sito dedicato Adobe per informazioni specifiche per il proprio caso.

Quale che sia l'ammontare di crediti generativi disponibili mensilmente, ogni azione costerà tipicamente 1 credito. Ad esempio, per quanto riguarda Photoshop, le funzioni Genera immagine, Genera sfondo, Genera simile, Riempimento generativo, Espansione generativa e Immagine di riferimento costeranno tutte 1 credito.

Anche in questo caso, rimandiamo alla pagina dedicata per informazioni dettagliate, che sicuramente evolveranno nel tempo ad esempio, al momento in cui scriviamo, gli effetti di testo di Adobe Express sono ancora a costo zero, ma avranno un costo diverso da zero (ancora incognito) a partire dal 1° luglio 2024.

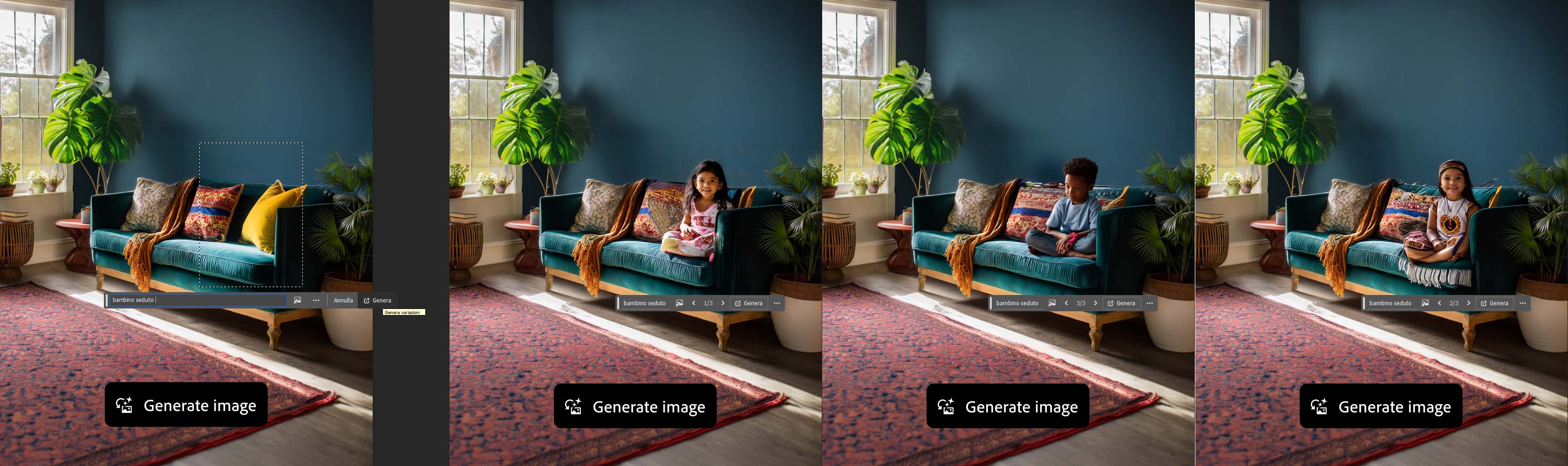

Un primo esempio di utilizzo dell'IA generativa per l'inserimento di elementi inesistenti. A prima vista il risultato è ottimo, anche se un'analisi più attenta svela tipicamente sempre la presenza di artefatti più o meno gravi.

Probabilmente qualcuno vivrà questa limitazione come una vessazione, ma a titolo personale siamo favorevoli. Sarebbe piuttosto ipocrita parlare di sostenibilità e assumere posizioni intransigenti (a carico altrui) mentre si consumano KWh per creare frivolezze da postare sui social

Tutto ciò premesso, è il momento di esaminare le novità tecniche.

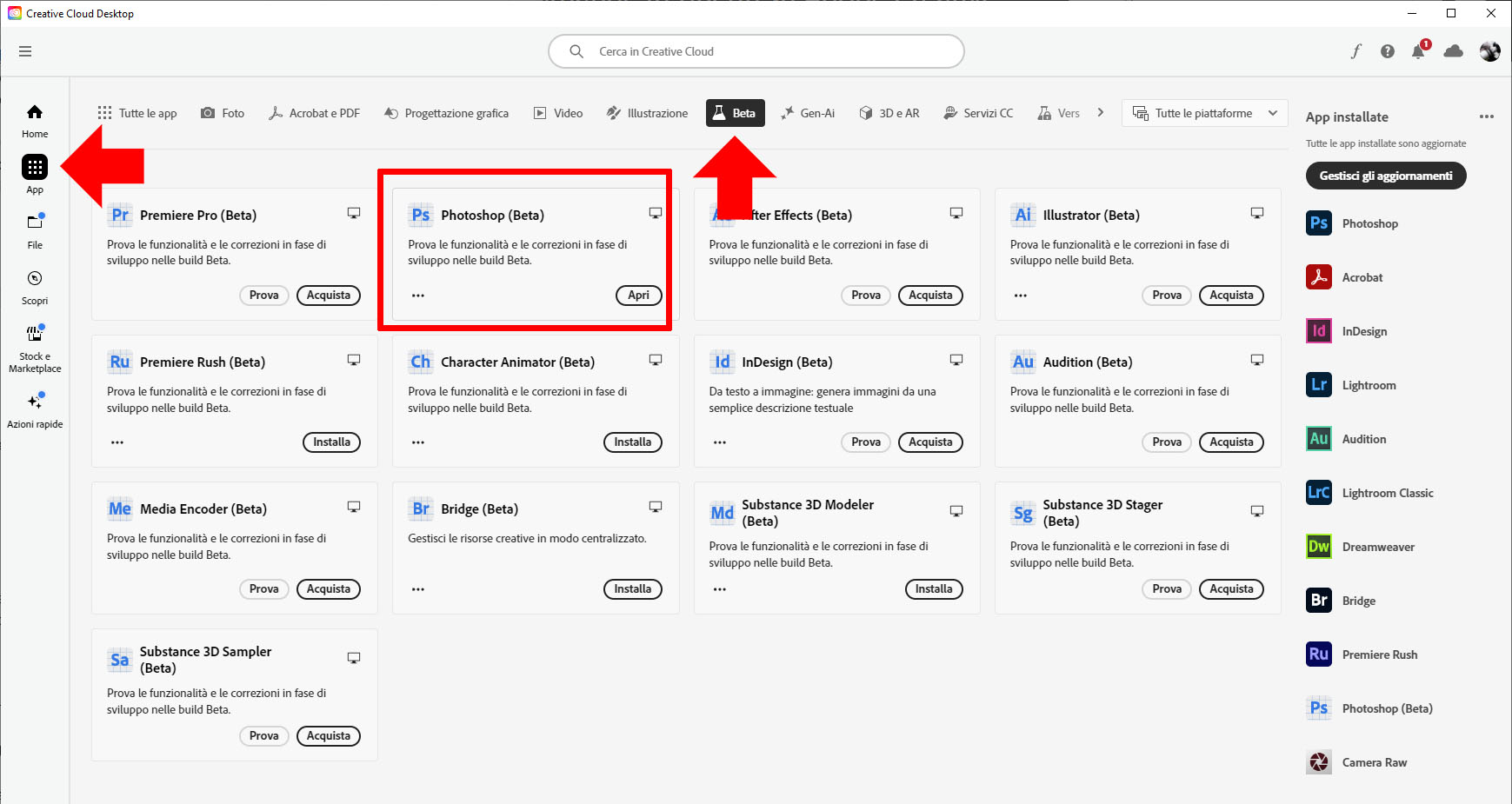

Ricordiamo che, volendo sperimentare in prima persona le novità di Firefly 3, è possibile farlo direttamente online partendo dal sito Adobe Firefly, mentre volendo valutare in modo più specifico le novità di Photoshop, è possibile installare l'App beta partendo da Creative Cloud Desktop (anche in periodo di prova 30 giorni), selezionando App nella colonna di sinistra, quindi Beta sulla barra orizzontale, infine Photoshop (Beta). Le applicazioni beta possono convivere con l'eventuale versione stabile già installata.

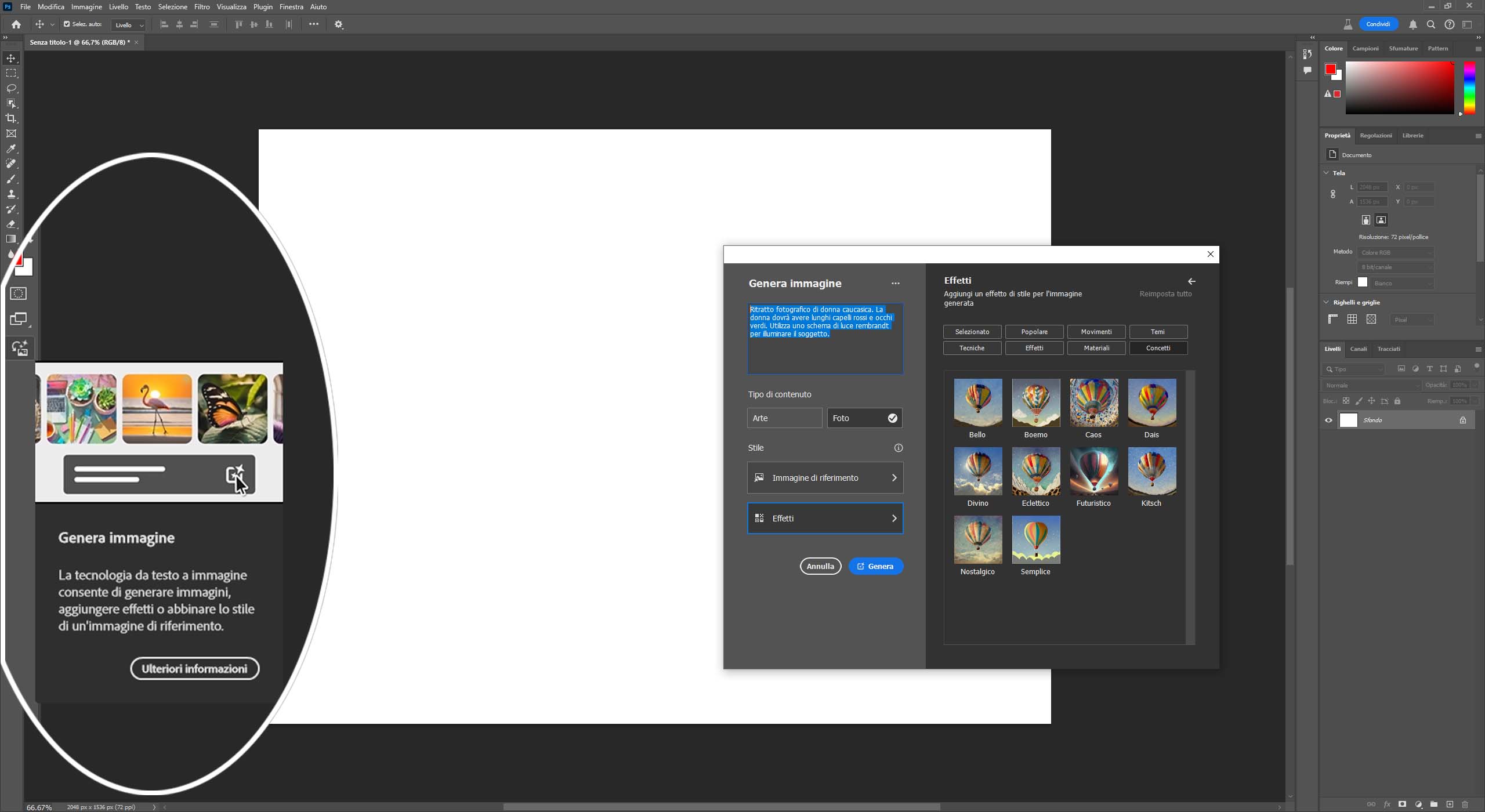

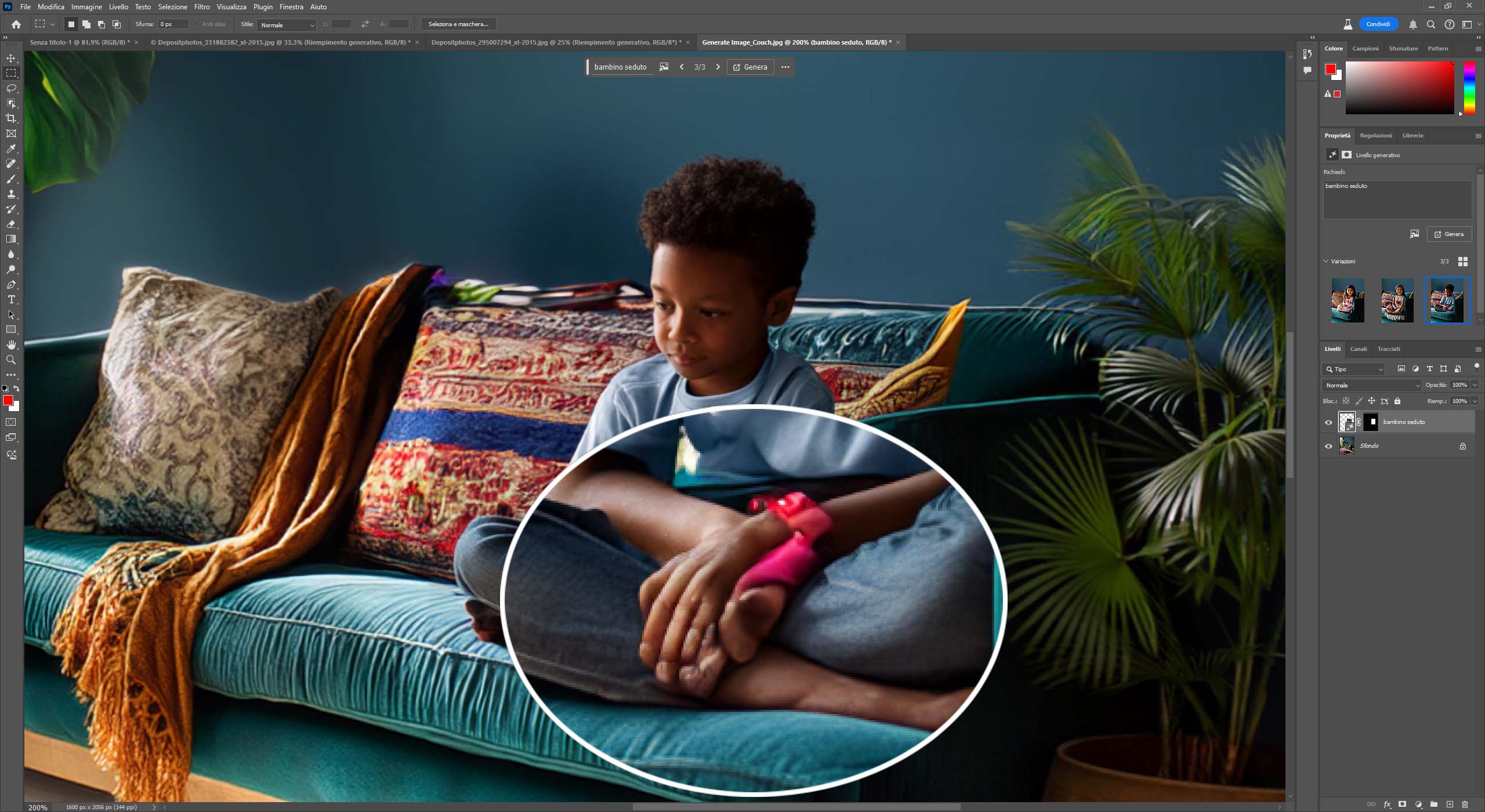

In Photoshop, la vera, grande novità riguarda la generazione di immagini a partire da prompt testuale, che ora, come anticipato, beneficia di uno strumento apposito e di una piccola interfaccia dedicata. Ciò significa che è possibile fare tutto, più comodamente, anche dentro Photoshop.

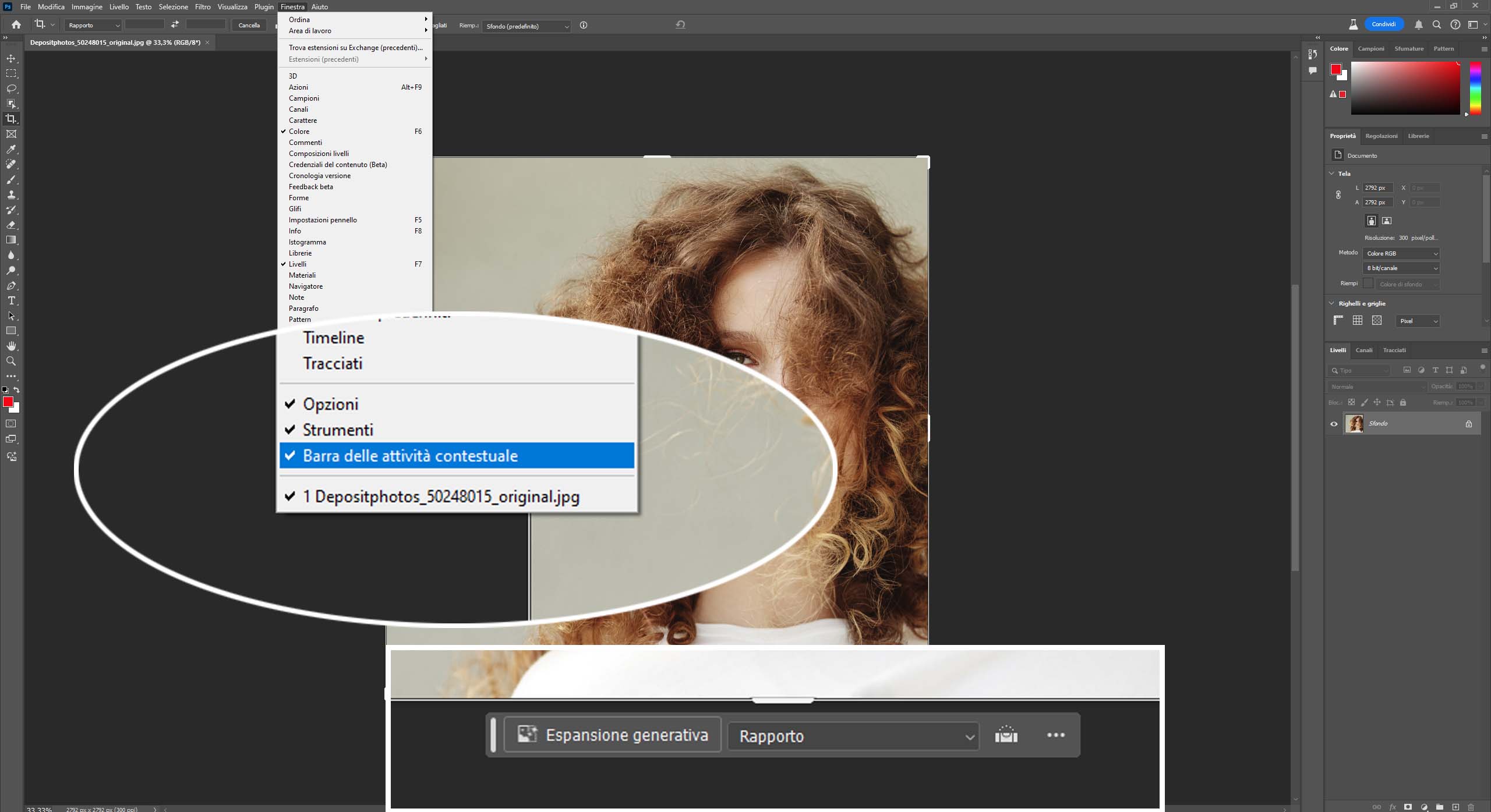

Per l'uso delle funzioni IA, la barra contestuale è fondamentale. Se non dovesse essere presente, si può richiamare spuntando Barra delle attività contestuale dal menu Finestra.

È possibile scegliere di generare un contenuto artistico, ad esempio un dipinto, oppure un'immagine fotorealistica, ed è possibile indirizzare l'IA specificando uno stile, un tema (Fumetto, pop-art, graffiti ), una tecnica (acrilico, olio su tela, chiaroscuro ), degli effetti (fotografia con grandangolo ), dei materiali o dei concetti astratti (futuristico, nostalgico, kitsch ).

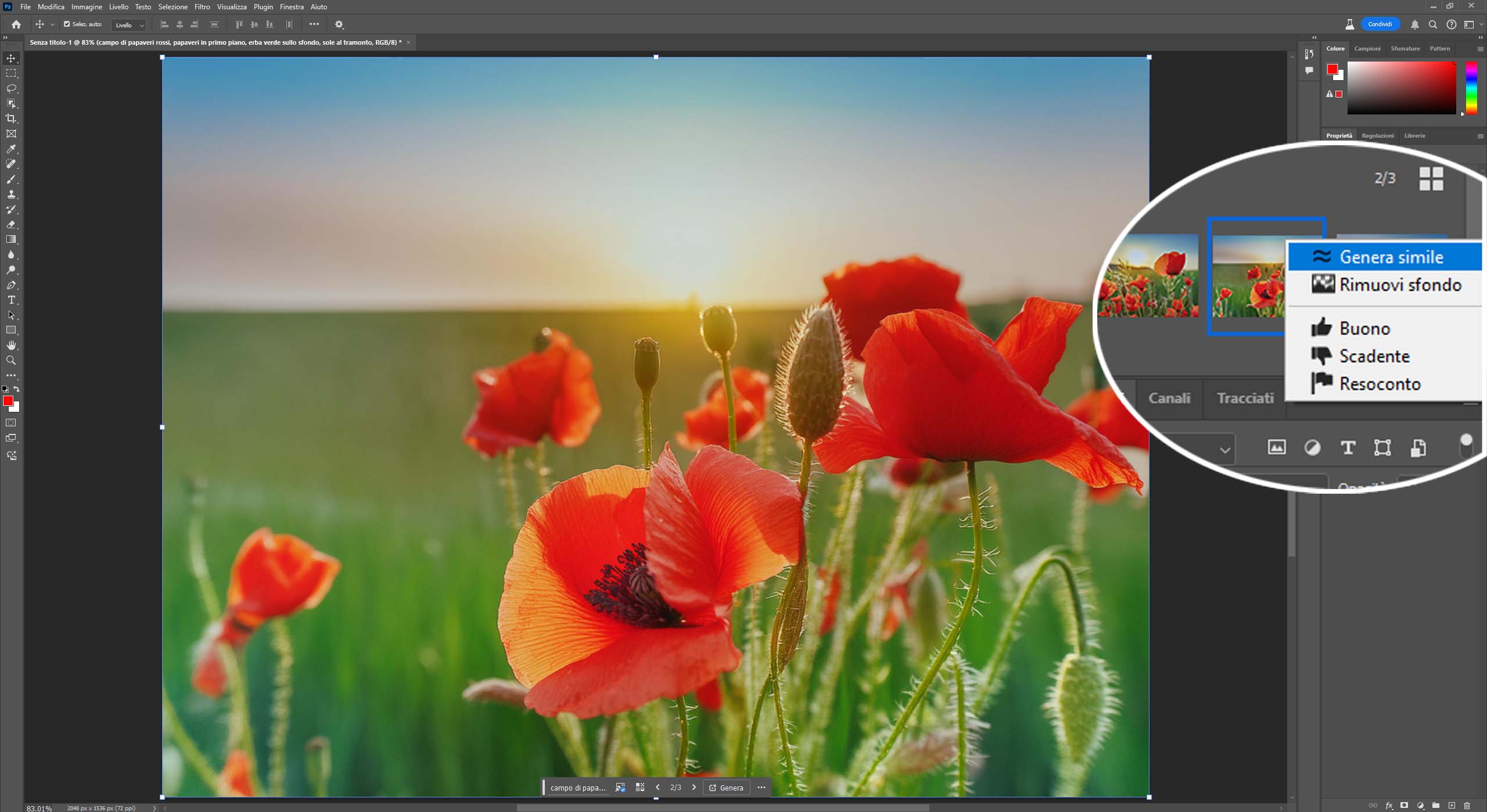

Il risultato sarà sempre un terzetto di proposte tra cui scegliere, e ora si aggiunge la funzione Genera simile, applicabile a una delle tre proposte, molto utile per indirizzare l'IA verso il risultato desiderato.

In questo senso, utile sottolineare come il prompt che ha generato l'immagine resti disponibile, e possa quindi essere comodamente modificato/affinato prima di premere nuovamente sul pulsante Genera. Ad esempio, è possibile passare da "vaso con fiori" a "vaso con 3 fiori" a "vaso con 3 fiori rossi". Ovviamente l'utilità della cosa si apprezza più in presenza di prompt complessi.

A proposito, il prompt di testo può essere più complesso che in precedenza, e viene meglio interpretato. Ad esempio:

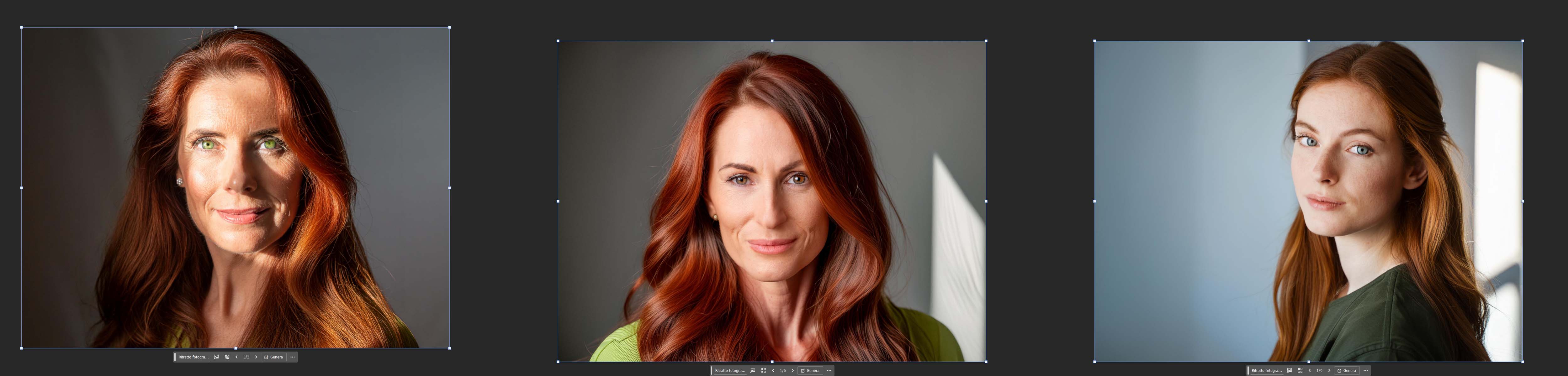

Ritratto fotografico di donna caucasica. La donna dovrà avere lunghi capelli rossi e occhi verdi. Utilizza uno schema di luce rembrandt per illuminare il soggetto.

Ha restituito una serie di risultati, di cui mostriamo tre esempi qui sopra, tutti piuttosto aderenti alla richieste (fatta eccezione per lo schema di illuminazione, ancora, evidentemente, oltre le possibilità dell'IA). La qualità fotografica è certamente cresciuta, anche se non soprattutto in termini di luce, e questo è senza dubbio uno dei punti di forza della soluzione Adobe.

Molto continua a dipendere, e non potrà essere diversamente in futuro, dalla disponibilità di immagini simili alla richiesta entro la biblioteca Adobe Stock, a cui l'IA può attingere. Se non c'è nulla di davvero aderente alla richiesta, il software arrancherà alla ricerca dell'immagine più simile possibile, che potrà però ovviamente essere anche molto distante dal risultato desiderato. E questo è, con tutta probabilità, il maggior punto debole di Firefly.

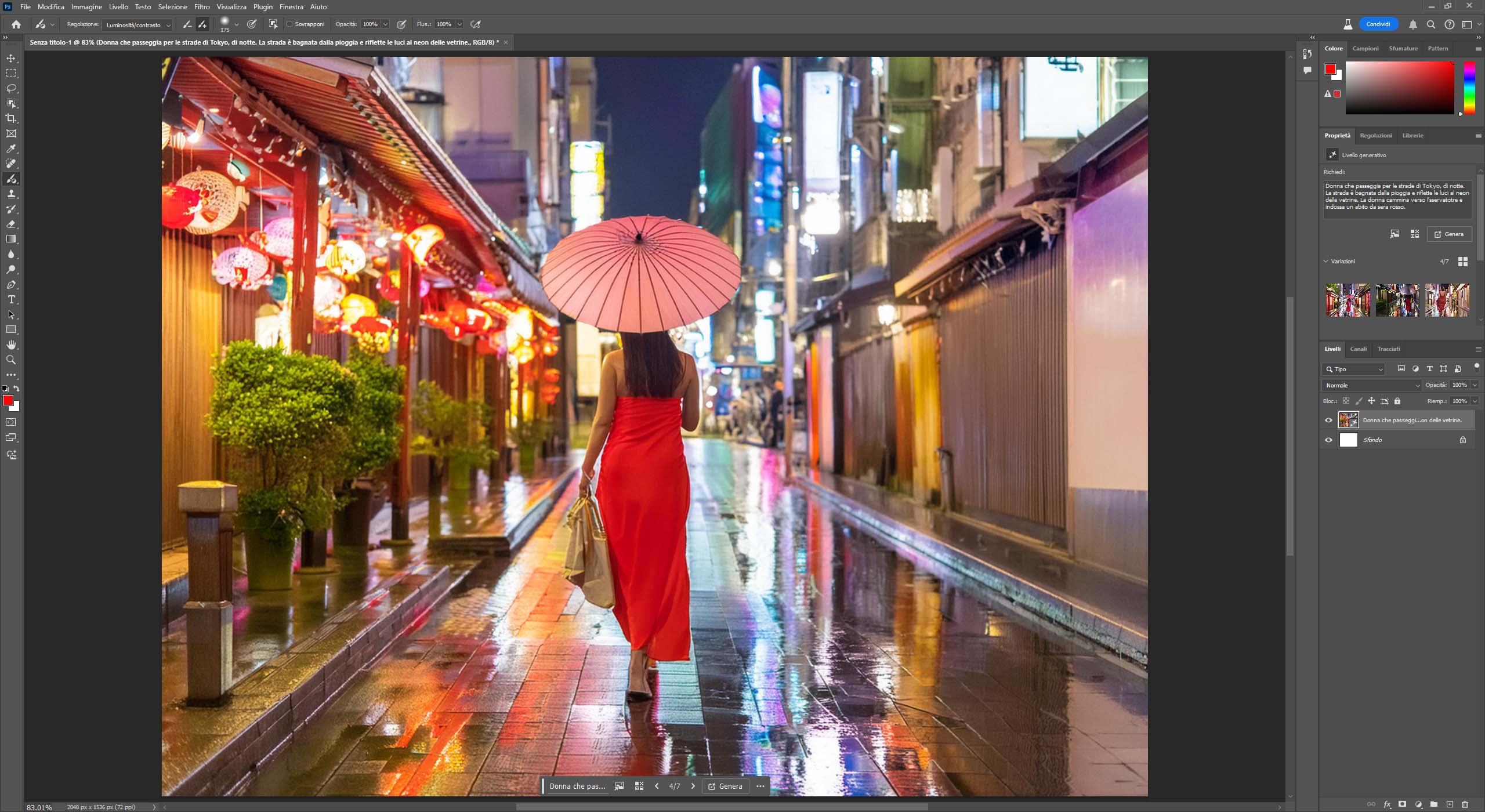

In alto: risultato di Adobe Photoshop beta. In basso: risultato di Bing Image Generator a parità di prompt, che richiedeva una donna in abito da sera rosso a passeggio per le strade (bagnate) di Tokio.

La biblioteca Adobe Sock, per quanto ampia, non è infinita, e la nostra impressione è che altre soluzioni abbiamo provato, banalmente, a dare in pasto gli stessi prompt a Bing Image Generator attingano a biblioteche ben più ampie e siano per questo in grado di dare fin dal primo tentativo un risultato mediamente più aderente alle aspettative.

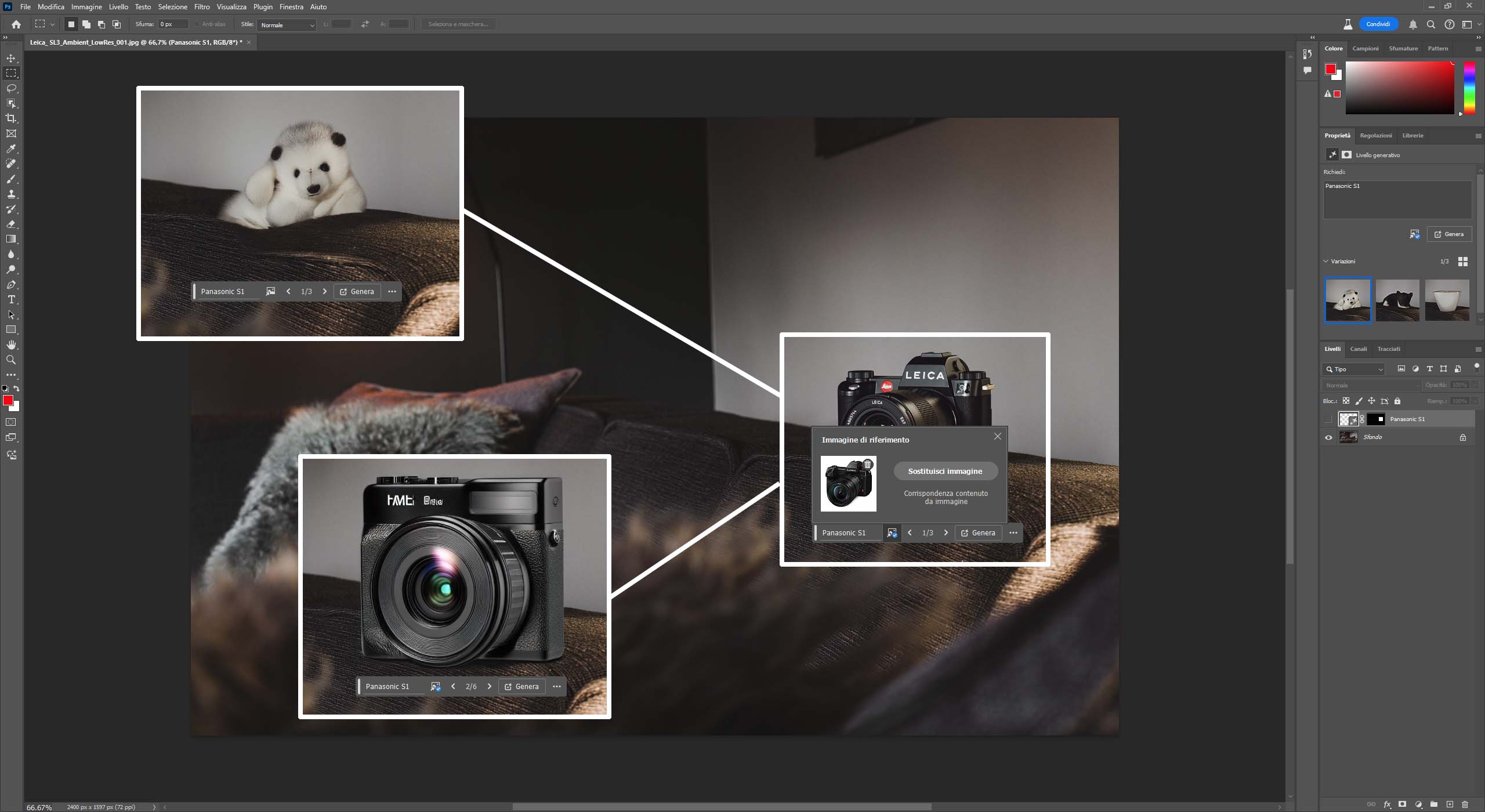

La possibilità di utilizzare un'immagine di riferimento è, in generale, un grande aiuto per indirizzare correttamente il software. Ad esempio, il prompt:

Campo di papaveri rossi. Papaveri in primo piano, erba verde sullo sfondo, sole al tramonto.

Ha generato in prima istanza i tre esempi qui sopra, tutti per inciso soddisfacenti, ma caricando un'immagine di esempio, l'IA ha restituito un risultato molto simile senza necessità di aggiungere istruzioni che, nel caso specifico, sarebbero dovute essere estremamente dettagliate.

A sinistra: immagine di riferimento. A destra: Immagine generata.

L'immagine di riferimento, in altri termini, elimina o riduce la necessità di scrivere prompt complessi in una sequenza trial-and-error che, in molti casi, può rivelarsi anche piuttosto lunga e laboriosa.

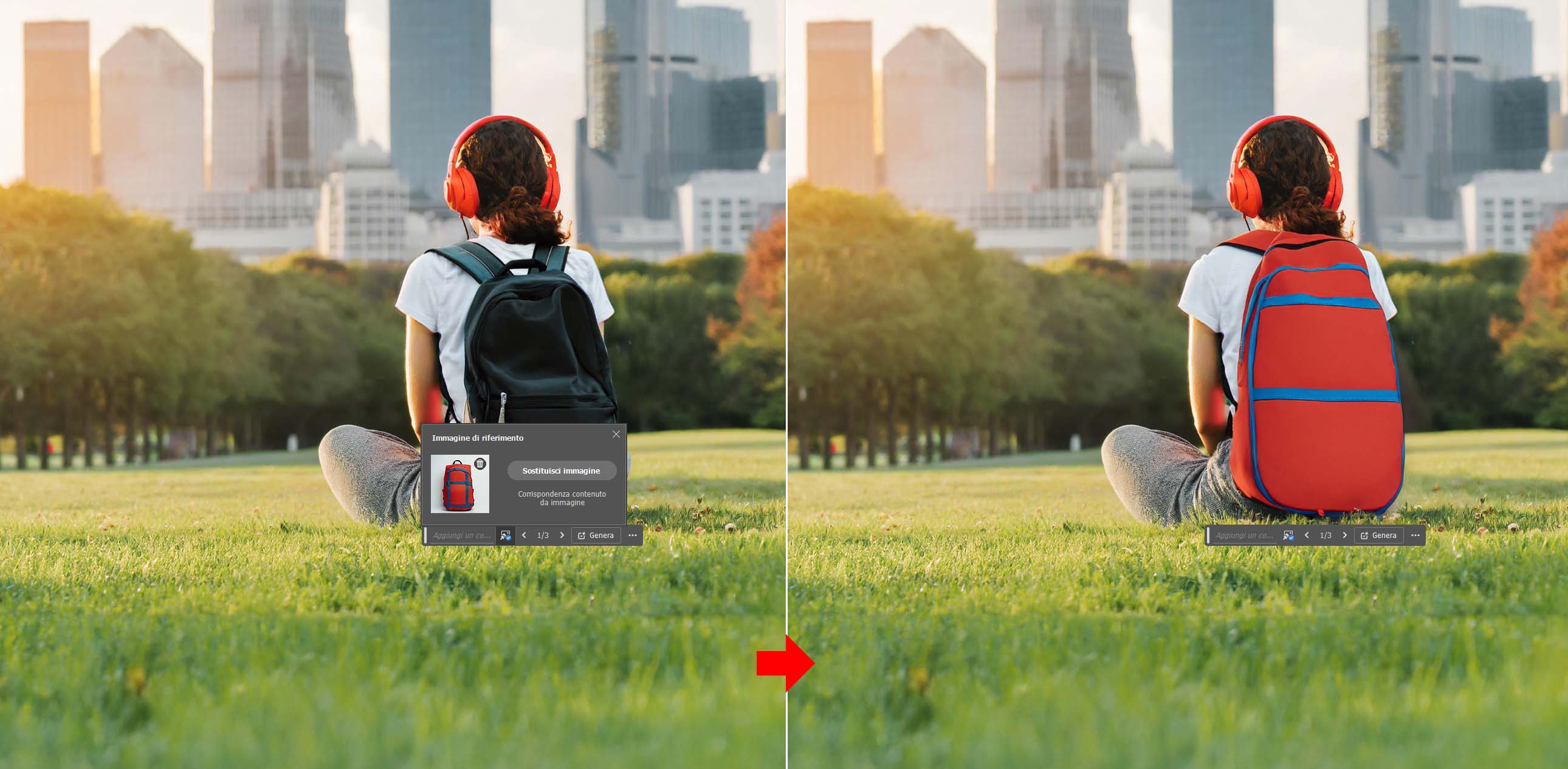

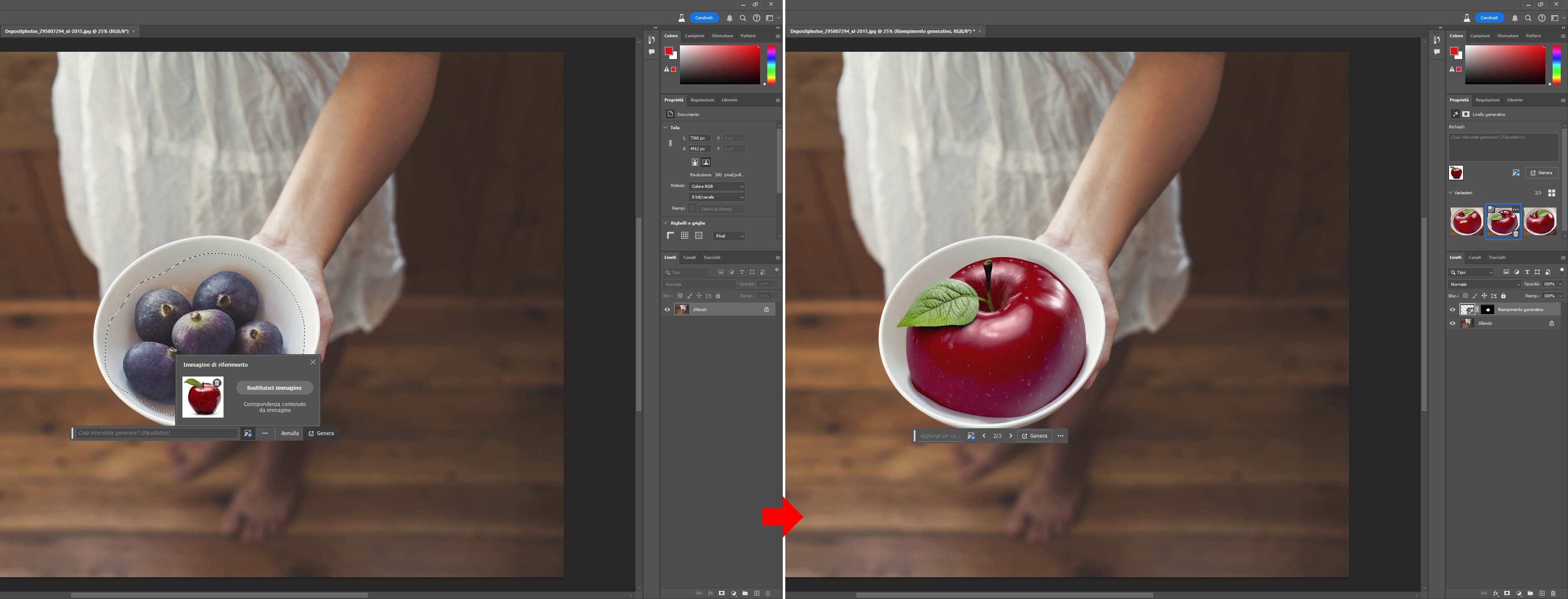

L'immagine di riferimento può essere utilizzata anche per una sostituzione selettiva, potenziando o rendendo più efficiente le funzioni di riempimento generativo già disponibili.

In questo contesto, l'immagine di esempio funge da "ispirazione" per l'IA, tipicamente per sostituire un oggetto presente sulla scena con un altro oggetto.

Tre esempi di sostituzione selettiva "ispirata" da un'immagine di riferimento (visibile nel menu contestuale di ciascuna schermata). Risultati molto diversi. In alto: operazione non perfetta, ma sufficiente a passare l'esame di uno sguardo superficiale. Al centro: risultato palesemente innaturale, richiederebbe uso di prompt testuale. In basso: la richiesta di sostituzione di una fotocamera Leica con una Panasonic ha dato (tra gli altri) questi due risultati. La fotocamera ricostruita da Adobe è assolutamente irrealistica ma, per lo meno, ricorda una vera fotocamera; come l'IA sia arrivata a inserire l'immagine di un cucciolo d'orso polare è un fitto mistero...

Difficilmente però si ottengono risultati perfetti, o anche solo plausibili, quando l'immagine in questione deve essere fotorealistica. Su questo fronte, ci sono sicuramente molti passi ancora da compiere

Tutto è ovviamente molto più semplice e convincente in caso di immagini astratte, disegni, fumetti, e contenuti che, in generale, non devono confrontarsi con la realtà.

Vale comunque la pena menzionare la nuova funzione Migliora dettagli, che esegue un upscaling della risoluzione dell'oggetto inserito per meglio inserirlo in immagini di partenza in alta risoluzione. La funzione si attiva cliccando sull'apposita icona nell'angolo superiore sinistro della miniatura (tra le tre proposte), e non consente di personalizzare alcunché.

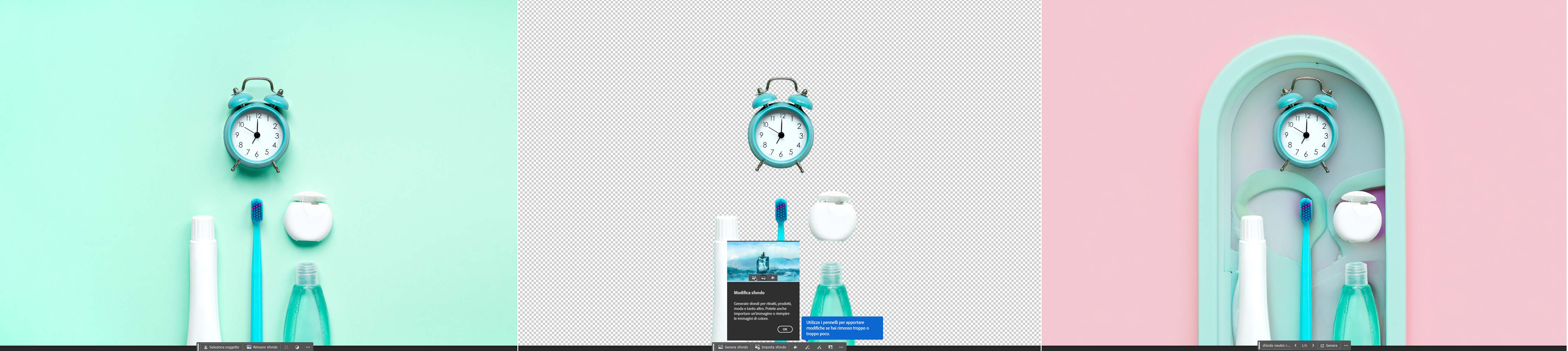

Per il resto, continuano a valere le valutazioni espresse per la versione di debutto 25.0, che possiamo sintetizzare in questo modo. Le funzioni di riempimento generativo sono già piuttosto mature e restituiscono ottimi risultati soprattutto quando si tratta di cancellare (rimozione di oggetti indesiderati, rimozione dello sfondo).

Fanno generalmente un buon lavoro anche quando si tratta di estendere la scena "inventando" parti inesistenti, a patto che la scena in questione non contenga geometrie precise (con cui ovviamente si notano maggiormente le imperfezioni).

Uno dei frequenti risultati inspiegabili che si ottengono con la funzione Sostituzione sfondo. Ottimo scontorno, ma perché, a fronte di un prompt che chiedeva uno sfondo neutro, è starta creata quella sorta di volta visibile a destra?.

L'inserimento/sostituzione di oggetti deve invece ancora migliorare molto. Non che sia impossibile, in particolari circostanze favorevoli, ottenere buoni risultati anche in questo campo, ma la maggioranza degli inserimenti non apparirà né realistica né plausibile.

In definitiva, possiamo dire che, a distanza di soli sei mesi dal debutto o poco più, la piattaforma generativa di Adobe abbia già compiuto importanti passi avanti: è infatti ora meglio integrata, e consente un dialogo più naturale con l'IA, sia perché accetta e interpreta meglio prompt più complessi, sia (soprattutto) per l'uso dell'immagine "di riferimento". È, dunque, in termini di usabilità che si vedono i progressi più sostanziali.

Viso generato da Bing (a sinistra) contro viso generato da Adobe (a destra). La differenza è notevole.

La qualità delle immagini fotorealistiche generate (ci riferiamo soprattutto ai volti umani) è aumentata apprezzabilmente, ed è ai vertici della categoria.

Il tallone d'Achille potrebbe essere la base di immagini di riferimento. Come già detto, abbiamo infatti avuto la sensazione che, a parità di prompt, altri strumenti generativi producessero immagini più aderenti alle aspettative fin dal primo tentativo, forse proprio grazie alla più ampia base di riferimento utilizzata. D'altro canto, con la sua base "chiusa" Adobe Sock, la piattaforma Adobe offre il massimo delle garanzie in termini di legalità, correttezza e rispetto dei diritti d'autore, un aspetto da non sottovalutare per i professionisti.